OpenAI近期震撼发布了两款全新AI模型——o3与o4-mini,这两款模型被公认为是OpenAI迄今为止最强大、最智能的成就。

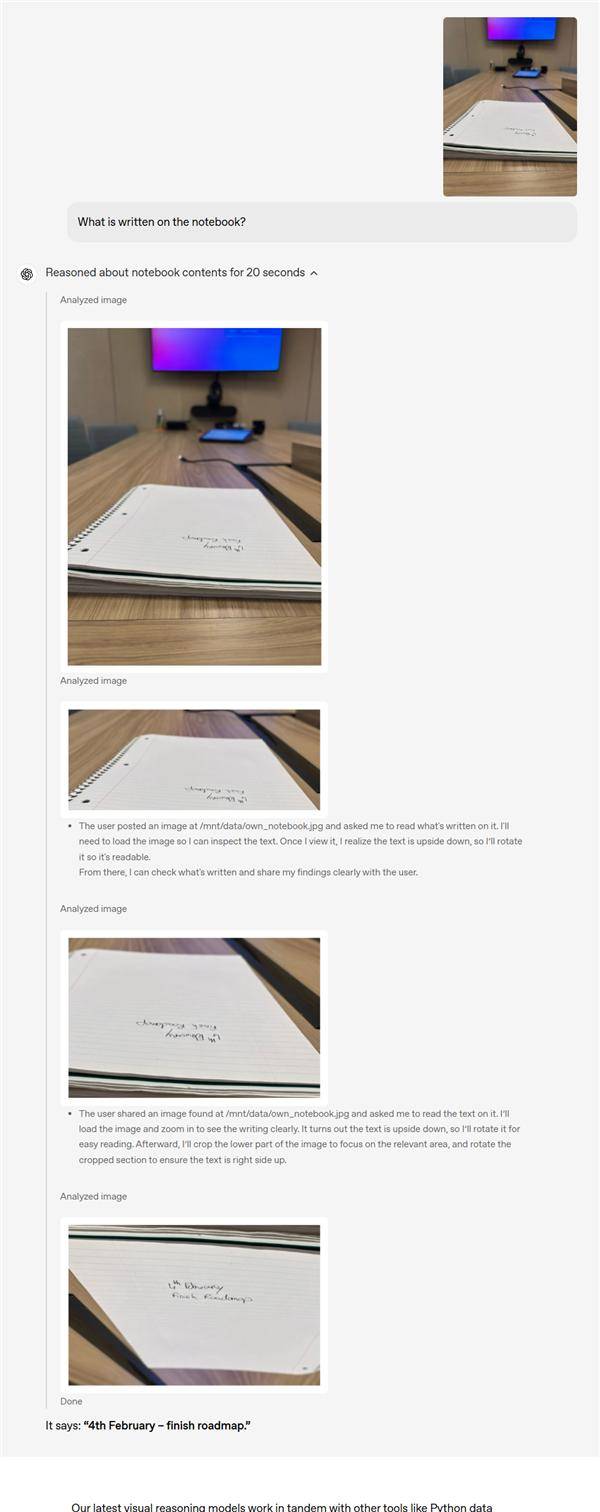

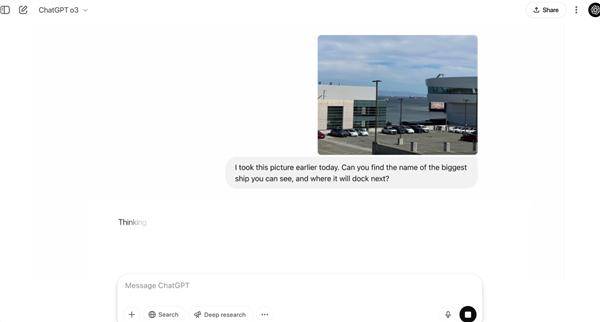

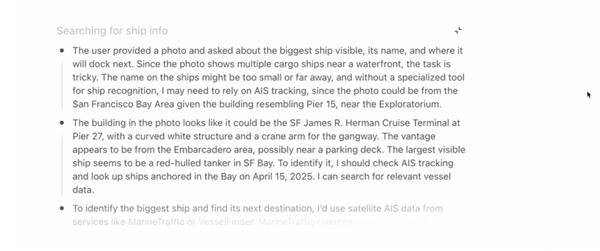

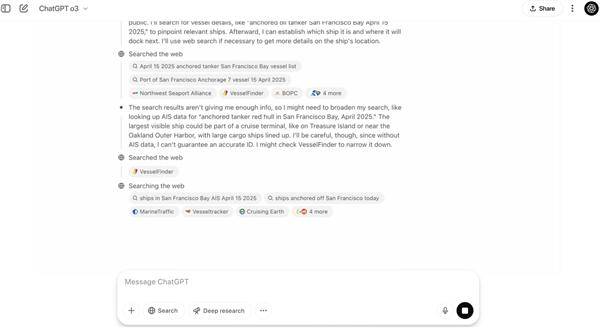

据悉,o3与o4-mini首次展现了真正的视觉推理能力,超越了以往单纯的图像识别,实现了看图思考的新高度。这一突破意味着AI不再仅仅是被动的观察者,而是能够主动理解和分析视觉信息的智能体。

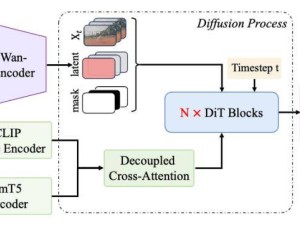

这两款模型的多模态处理能力同样令人瞩目,它们能够同时处理文本、图像和音频信息,并且作为智能Agent,能够自动调用网络搜索、图像生成、代码解析等工具,以及进入深度思考模式。这种全面的能力使得o3与o4-mini在处理复杂任务时更加游刃有余。

通过强化学习,OpenAI成功训练了o3与o4-mini如何使用各种工具。它们不仅知道何时、如何使用这些工具,还能以正确的格式迅速生成可靠的答案。这一进步显著提升了AI的实用性和效率。

在AIME数学竞赛中的表现进一步证明了o3与o4-mini的实力。在2024年的竞赛题目中,o3与o4-mini(无工具版本)的准确率分别高达91.6%和93.4%,远超前款模型o1的74.3%。而在2025年的题目中,它们的准确率也分别达到了88.9%和92.7%。在Codeforces编程竞赛评分中,支持终端工具的o3与o4-mini分别取得了2706和2719的ELO分数,同样领先o1和o3-mini。

为了让更多用户能够体验到这两款强大模型,OpenAI宣布,即日起,ChatGPT的Plus、Pro会员以及Team用户将可以直接使用o3、o4-mini以及更高版本的o4-mini-high。